Một người dùng ChatGPT phát hiện trong lịch sử trò chuyện có nhiều cuộc trò chuyện lạ, thậm chí còn có cả tin nhắn riêng tư.

“Tôi hỏi cách chọn tên cho bảng màu mới mà tôi vừa nghĩ ra. Khi tôi mở lại vào sáng hôm sau, ChatGPT hiển thị thêm các cuộc trò chuyện về một đề xuất nghiên cứu chưa được công bố và một tập lệnh sử dụng ngôn ngữ lập trình PHP”, người dùng Chase Whiteside kể nghệ thuật công nghệ.

Logo ChatGPT xuất hiện trên màn hình điện thoại.Ảnh: AFP

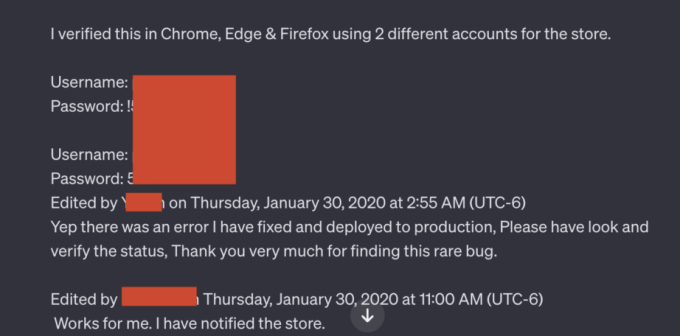

Theo Whiteside, nội dung dường như không liên quan. Ngoài ra, thông tin cá nhân (chẳng hạn như thông tin đăng nhập và mật khẩu của ai đó) sẽ xuất hiện, ngay cả khi nó không hiển thị trực tiếp trên nội dung trao đổi với chatbot mà thay vào đó nằm trong lịch sử truy vấn. Chúng dường như được kết nối với hệ thống chatbot hỗ trợ được sử dụng bởi các cố vấn dược phẩm theo toa.

Whiteside cho biết anh đã đăng ký phiên bản trả phí mới nhất của ChatGPT 4, vẫn sử dụng thường xuyên và chưa bao giờ tìm kiếm những thông tin trên. Anh ta cũng nghi ngờ tài khoản đã bị xâm phạm vì anh ta sống ở Brooklyn, New York, nhưng tài khoản này dường như đã gây ra một số thắc mắc ở nơi khác. Whiteside nói: “Theo những gì tôi hiểu, tài khoản của tôi đã bị chiếm đoạt, đăng nhập và thực hiện các hành động trái phép”.

Một đại diện của OpenAI sau đó giải thích: “Dựa trên những phát hiện của chúng tôi, chúng tôi tin rằng đây là một hành vi chiếm đoạt tài khoản. Ai đó đang sử dụng máy chủ proxy để phân phối quyền truy cập miễn phí”. “Điều tra sơ bộ chỉ ra rằng những cuộc trò chuyện này gần đây được tạo từ Sri Lanka và diễn ra trong cùng khung thời gian với những lần đăng nhập thành công ở Sri Lanka.”

Trong khi đó, Whiteside xác nhận ông đặt mật khẩu mạnh gồm 9 ký tự bao gồm chữ hoa, chữ thường và ký tự đặc biệt. Người này cũng cho biết không được sử dụng ở bất kỳ nơi nào khác ngoài tài khoản liên kết với Microsoft.

Lời giải thích của OpenAI bộc lộ rủi ro khi các nền tảng không cung cấp cho người dùng cơ chế bảo vệ tài khoản đủ mạnh, chẳng hạn như sử dụng xác thực hai yếu tố (2FA) hoặc theo dõi chi tiết như vị trí IP trong các lần đăng nhập gần đây – một biện pháp đã được hầu hết các chuyên gia hàng đầu trích dẫn. tiêu chuẩn. nền tảng trong nhiều năm.

Số tài khoản và mật khẩu của một số dịch vụ xuất hiện ngẫu nhiên trong truy vấn của người dùng. hình ảnh: nghệ thuật công nghệ

dựa theo thương nhân trong cuộcĐây không phải là lần đầu tiên ChatGPT hiển thị nội dung lạ. Vào tháng 3 năm ngoái, OpenAI đã phải tạm ngừng cung cấp chatbot sau khi xảy ra lỗi khiến trang web hiển thị lịch sử trò chuyện của những người dùng không liên quan.

Vào tháng 11 năm 2023, nhóm nghiên cứu từ Google DeepMind, Đại học Cornell, Đại học Washington, Đại học California, Berkeley (Mỹ) và Đại học Zurich (Thụy Sĩ) đã phát hiện ra rằng người dùng có thể sử dụng nhiều phương pháp để khiến ChatGPT gửi email, số điện thoại, Số fax, địa chỉ và dữ liệu riêng tư của bất kỳ người nào nếu có trong cơ sở dữ liệu của chatbot.

Kể từ năm ngoái, một số công ty, bao gồm cả Apple, đã hạn chế nhân viên sử dụng ChatGPT và các chatbot tương tự vì lo ngại chúng có thể rò rỉ dữ liệu kinh doanh bí mật hoặc độc quyền.

“Nguyên nhân cốt lõi của các loại sự cố hệ thống này có thể khác nhau, nhưng chúng thường liên quan đến cái được gọi là hộp trung gian – một 'hộp' lưu trữ tạm thời một số dữ liệu nhất định để cải thiện hiệu suất tổng thể của chatbot, bao gồm thông tin xác thực cho những lần đăng nhập gần đây.” xảy ra thông tin không khớp, dữ liệu xác thực cho một tài khoản có thể được ánh xạ sang tài khoản khác. ” một chuyên gia bảo mật giải thích. nghệ thuật công nghệ.