Công cụ quy mô wafer 3 (WSE-3) của Cerebras, được công ty gọi là chip AI mạnh nhất hiện nay, có thể hỗ trợ lập trình trò chơi hơn hai giây.

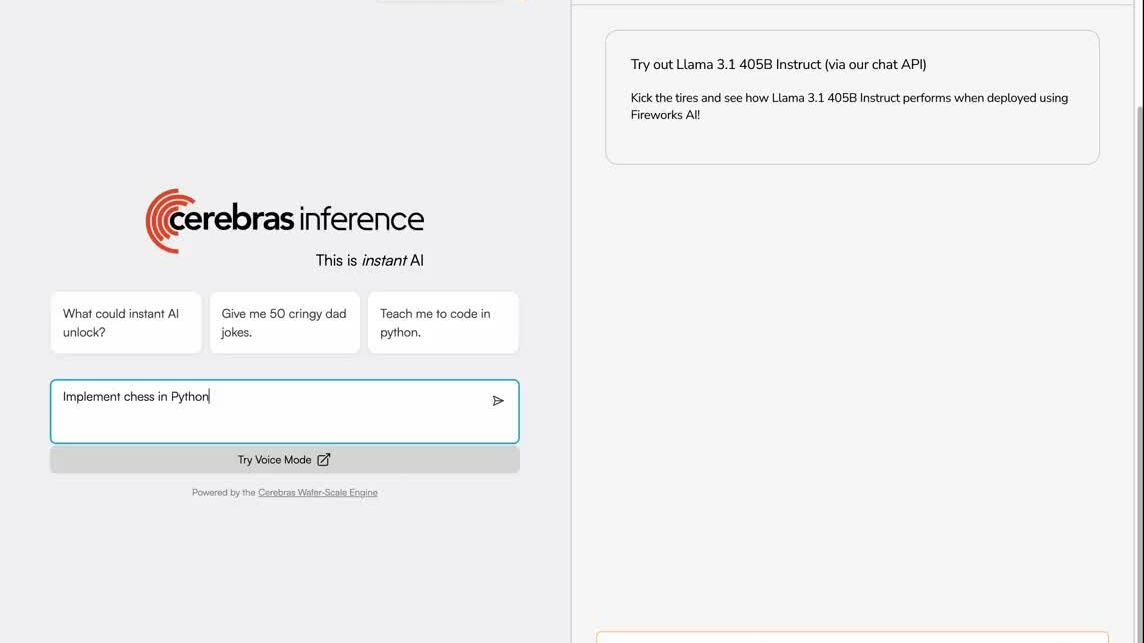

Trong video được chia sẻ tại dịch vụ đám mây AI Cerebras Inference, một ván cờ được viết bằng Python và sau đó được so sánh với một hệ thống khác cũng chạy LLM của Meta nhưng sử dụng dịch vụ đám mây Amazon Web Services (AWS) và GPU NVIDIA.

Thời gian tạo trò chơi cờ vua Cerebras Inference (trái) so với trí tuệ nhân tạo dựa trên đám mây AWS. băng hình: X/bộ não

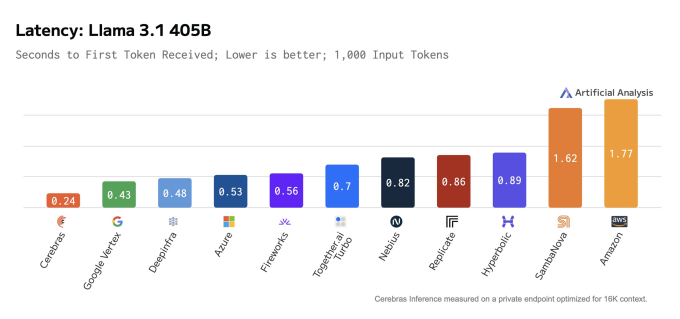

Do đó, hệ thống của Cerebras có khả năng tạo ra 972 mã thông báo mỗi giây (một mã duy nhất từ phản hồi LLM) và thời gian khởi chạy mã thông báo đầu tiên là 0,24 giây. Do đó, hệ thống của Cerebras mất hơn hai giây để lập trình một ván cờ. Đây là kỷ lục thế giới hiện tại. Trong khi đó, hệ thống AWS mất gần 20 giây.

Cerebras cũng so sánh một loạt AI hàng đầu khác của Google, Microsoft Azure hay Fireworks, tất cả đều cho kết quả xuất sắc. SambaNova là đối thủ cạnh tranh trực tiếp của WSE-3 và cũng bị Cerebras Inference đánh bại nhanh hơn gấp 6 lần.

Thời gian xử lý mã thông báo đầu tiên trên hệ thống Cerebras sử dụng mô hình Llama 3.1 405B so với đối thủ cạnh tranh. hình ảnh: X/bộ não

Cerebras cho biết: “Llama 3.1 405B trên Cerebras là mẫu nhanh nhất thế giới tính đến thời điểm hiện tại, nhanh hơn 12 lần so với GPT-4o và nhanh hơn 18 lần so với Claude 3.5 Sonnet.” Phần cứng của Tom. “Nhờ sự kết hợp giữa cách tiếp cận mở của Meta và công nghệ suy luận đột phá của Cerebras, Llama 3.1 405B hiện chạy nhanh hơn 10 lần so với LLM đóng hiện có trên thị trường.”

Ngoài ra, theo đại diện của Cerebras, Cerebras Inference vẫn sẽ chạy ở tốc độ 539 token mỗi giây ngay cả khi kích thước truy vấn tăng từ 1.000 token lên 100.000 token (lời nhắc bao gồm ít nhất vài nghìn từ). Các đối thủ cạnh tranh hiện tại đạt 49 token mỗi giây.

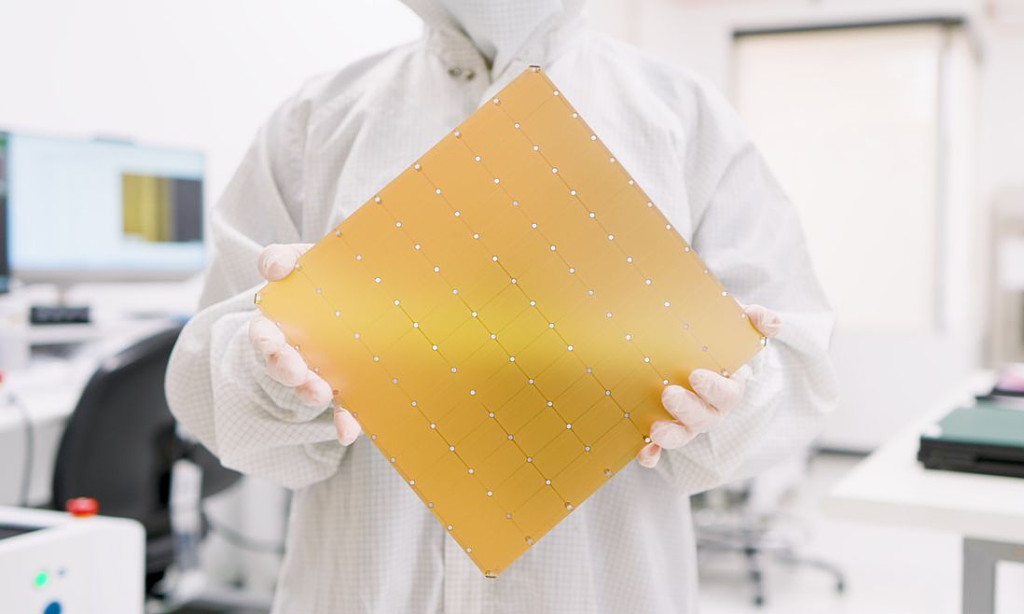

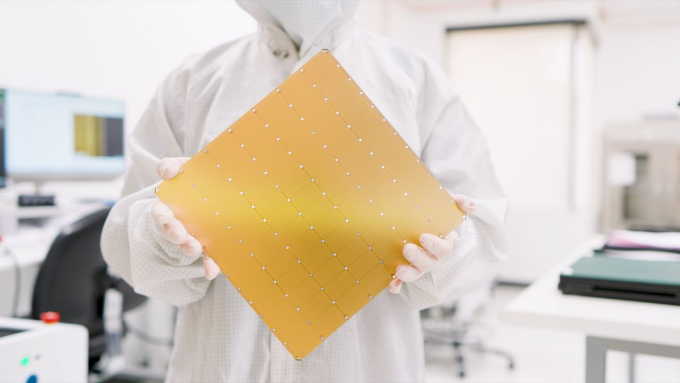

Kích thước chip WSE-3. hình ảnh: não

Ra mắt vào tháng 3, WSE-3 là nền tảng thế hệ thứ ba của Cerebras được thiết kế để cung cấp năng lượng cho các hệ thống trí tuệ nhân tạo như GPT-4 của OpenAI và Claude 3 Opus của Anthropic. Con chip này chứa 4 nghìn tỷ bóng bán dẫn, 900.000 lõi AI và được làm từ một tấm wafer silicon 21,5 x 21,5 cm. Con chip này giống hệt với người tiền nhiệm năm 2021, WSE-2, tiêu thụ cùng mức năng lượng nhưng mạnh gấp đôi. Để so sánh, Nvidia H200, một trong những con chip mạnh nhất hiện nay được sử dụng để huấn luyện các mô hình AI, hiện có 80 tỷ bóng bán dẫn, ít hơn 57 lần so với chip Cerebras.

- AMD ra mắt chip AI cạnh tranh với Nvidia

- Startup Mỹ ra mắt chip trí tuệ nhân tạo “mạnh gấp 20 lần Nvidia H100”