Với sự trợ giúp của trí tuệ nhân tạo, khoảng 61% mật khẩu có thể bị bẻ khóa trong vòng chưa đầy một phút, nhanh hơn gần ba lần so với các phương pháp bẻ khóa truyền thống.

Thống kê được các nhà nghiên cứu của Kaspersky công bố tại hội nghị bảo mật CSW 2024 tuần trước cho thấy trong bối cảnh trí tuệ nhân tạo phát triển và khai thác độc hại, nguy cơ rò rỉ mật khẩu ngày càng gia tăng dù người dùng có ý thức đặt mật khẩu mạnh.

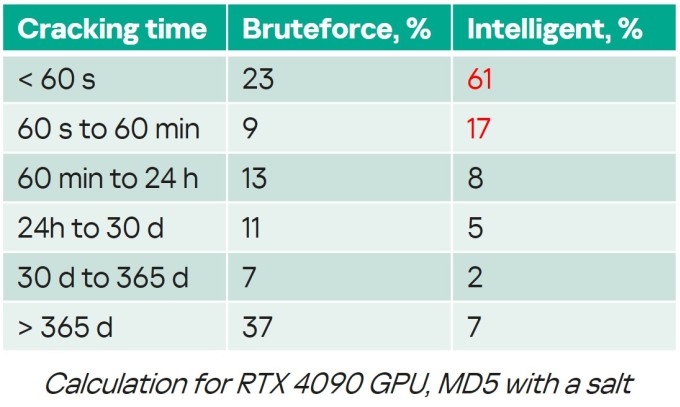

Hiện tại, mật khẩu thường được người dùng tạo ở dạng văn bản thuần túy và sau đó được bảo vệ bằng hàm băm tạo ra các chuỗi gần như không thể đọc hoặc đảo ngược. Để phát hiện, một trong những phương pháp được tin tặc sử dụng là brute-force, kiểm tra các chuỗi cho đến khi tìm thấy mật khẩu. Nghiên cứu của Kaspersky cho thấy khi sử dụng phương pháp này, khoảng 23% mật khẩu có thể được phát hiện trong vòng 60 giây và 9% có thể bị bẻ khóa trong vòng 1-60 phút.

Tuy nhiên, kẻ tấn công có thể tận dụng cơ sở dữ liệu mật khẩu bị đánh cắp bị rò rỉ trước đây và dễ dàng xây dựng mô hình trí tuệ nhân tạo của riêng chúng để cải thiện khả năng đoán và thậm chí đảo ngược mật khẩu được mã hóa trở lại ký tự ban đầu. Ví dụ: tập dữ liệu 10 tỷ mật khẩu được chia sẻ vào tháng 7 đóng vai trò là nguồn dữ liệu lớn cho các mô hình này.

Alexey Antonov, giám đốc nghiên cứu AI tại Kaspersky, cho biết nhóm của ông đã đào tạo một mô hình AI để phân tích mật khẩu bị rò rỉ và nhận thấy tốc độ bẻ khóa tăng lên đáng kể. Khoảng 32% mật khẩu có thể được khôi phục từ dạng băm trong vòng 60 phút.

Khi chạy các ứng dụng AI với tốc độ 164 tỷ băm mỗi giây trên phần cứng GPU RTX 4090 và chức năng băm MD5, 61% mật khẩu đã bị bẻ khóa trong 60 giây và 17% mật khẩu bị bẻ khóa trong 1-60 phút, vâng, độ tương phản gấp ba lần. theo phương pháp vũ phu cũ.

Thống kê tỷ lệ bẻ khóa mật khẩu của các ứng dụng AI và bẻ khóa brute Force của Kaspersky trong các khoảng thời gian khác nhau (phải). ảnh chụp màn hình

Thói quen sử dụng mật khẩu của người dùng là một trong những yếu tố khiến họ dễ dàng bị AI bẻ khóa. Những mật khẩu sử dụng các ký tự liên quan hoặc các chuỗi thông dụng như “admin”, “password”, “qwerty12345”, “nguyen”… đều có trong “từ điển” của hacker và rất dễ tìm. Đặt mật khẩu dài chứa chữ cái, số và ký tự đặc biệt hoặc sử dụng trình tạo mật khẩu ngẫu nhiên được các chuyên gia khuyên dùng để giảm nguy cơ bị hack.

Nguy cơ tấn công mạng gia tăng trong thời đại trí tuệ nhân tạo

Trong bối cảnh trí tuệ nhân tạo ngày càng được sử dụng nhiều trong cuộc sống và công việc, những kẻ tấn công cũng có nhiều phương thức mới. Antonov cảnh báo: “Trí tuệ nhân tạo là một công cụ mạnh mẽ nhưng kẻ thù của chúng ta cũng sử dụng nó”.

Chuyên gia cho biết, ngoài việc sử dụng AI làm công cụ phát hiện mật khẩu nhanh hơn hoặc sử dụng AI như ChatGPT để viết mã độc và tự động hóa các cuộc tấn công, những kẻ lừa đảo cũng có thể sử dụng AI để thực hiện các cuộc tấn công kỹ thuật xã hội nhằm vào người dùng.

Ông Alexey Antonov chia sẻ tại sự kiện. hình ảnh: Lữ Quế

Một ví dụ điển hình là việc sử dụng trí tuệ nhân tạo để tạo văn bản, hình ảnh, âm thanh và video nhằm tạo ra nội dung sai sự thật, giả mạo sâu sắc và lừa đảo. Vào tháng 2 năm nay, một trong những cuộc tấn công tinh vi nhất từng xảy ra ở Hồng Kông. Những kẻ lừa đảo đã sử dụng deepfake để mạo danh CEO và tổ chức một cuộc họp trực tuyến để thuyết phục nhân viên tài chính chuyển 25 triệu USD.

Thống kê của Kaspersky cho thấy 21% email lừa đảo hiện nay được tạo ra bởi bot. Ngoài ra, trong các sự kiện lớn như Halloween, Black Friday, New Year, lượng nội dung AI tăng lên đáng kể, cho thấy các nhóm tấn công đang lợi dụng công nghệ để phát tán nội dung lừa đảo trên quy mô lớn.

Tại hội nghị bảo mật tổ chức tại Việt Nam hồi tháng 5, các cơ quan quản lý và chuyên gia cũng cho rằng, trong bối cảnh nguy cơ tấn công mạng ngày càng gia tăng trong kỷ nguyên AI, cần thực hiện giám sát pháp lý đối với các nhà phát triển AI.

Trung tá Nguyễn Anh Tuấn, Phó Giám đốc Trung tâm Dữ liệu Dân số Quốc gia, Bộ Công an, đưa ra ví dụ trí tuệ nhân tạo có thể tạo ra nhiều ứng dụng sử dụng hình ảnh, ứng dụng, tên website giả mạo của Bộ Công an để dụ dỗ người dân. Tải xuống, cài đặt và điền số CCCD, mật khẩu đăng nhập và các thông tin khác. Ông đề xuất hành lang pháp lý cho trí tuệ nhân tạo cần được cải thiện càng sớm càng tốt để duy trì vị trí dẫn đầu, đồng thời cần ban hành các văn bản để điều chỉnh đạo đức như quyền riêng tư trong nghiên cứu và phát triển, sản xuất, ứng dụng và sử dụng của trí tuệ nhân tạo. Dữ liệu cá nhân và nhân quyền của các tổ chức trong và ngoài nước.

Van Delong, Thứ trưởng Bộ Công nghệ thông tin và Truyền thông, cho rằng trí tuệ nhân tạo đang định hình lại hầu hết các ngành công nghiệp, trong đó có an ninh thông tin mạng. Trí tuệ nhân tạo đang được ứng dụng cho cả “tiền tuyến” tấn công mạng và phòng thủ hệ thống. Ông đề nghị các tổ chức cần ứng dụng trí tuệ nhân tạo để tăng cường bảo mật thông tin mạng, tận dụng khả năng phân tích các tập dữ liệu lớn ở tốc độ cao, sàng lọc dữ liệu lớn để xác định hành vi bất thường và phát hiện các hoạt động có hại mà công nghệ truyền thống không thể xử lý được.

Lữ Quế