Báo cáo mới do các đối tác chính phủ Mỹ ủy quyền cảnh báo rằng trí tuệ nhân tạo có thể gây ra “mối đe dọa ở cấp độ tuyệt chủng” đối với nhân loại, đòi hỏi phải có ngưỡng kiểm soát.

Phóng viên thời gian Bộ sưu tập có tên “Kế hoạch hành động nhằm tăng cường an ninh và đảm bảo cho trí tuệ nhân tạo tiên tiến”, đề xuất một bộ chính sách và hành động AI sâu rộng chưa từng có. Nếu được ban hành, chúng có thể cách mạng hóa ngành trí tuệ nhân tạo.

Phần giới thiệu của báo cáo viết: “Sự phát triển của trí tuệ nhân tạo tiên tiến đặt ra những rủi ro cấp bách và ngày càng tăng đối với an ninh quốc gia”. .”

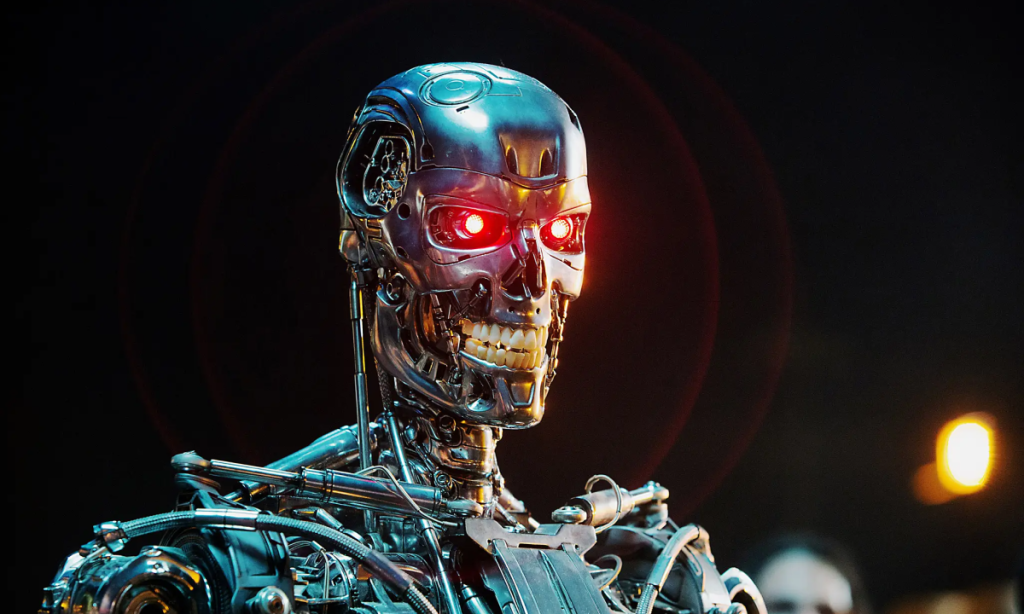

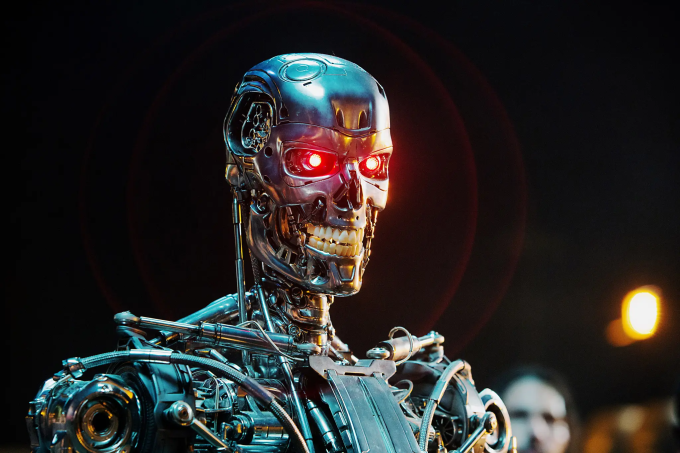

Robot trong phim “Kẻ hủy diệt”. hình ảnh: Tối thượng

Cụ thể, báo cáo khuyến nghị Quốc hội Hoa Kỳ nên quy định việc đào tạo các mô hình AI trên mức sức mạnh tính toán nhất định là bất hợp pháp, nghĩa là cần phải thiết lập và kiểm soát ngưỡng sức mạnh cho các công cụ AI. Cơ quan trí tuệ nhân tạo liên bang. Cơ quan này sẽ được phép yêu cầu các công ty trí tuệ nhân tạo xin giấy phép của chính phủ để đào tạo và triển khai các mô hình mới theo ngưỡng quy định.

Việc kiểm soát việc đào tạo các hệ thống AI tiên tiến trên một ngưỡng nhất định sẽ giúp “điều tiết” sự cạnh tranh giữa các nhà phát triển AI, từ đó giúp làm chậm sự cạnh tranh trong sản xuất phần cứng và phần mềm. Theo thời gian, các cơ quan quản lý AI liên bang có thể nâng ngưỡng cho các hệ thống AI khi chúng “cảm thấy đủ an toàn” và cho phép đào tạo hệ thống AI tốt hơn hoặc hạ thấp ngưỡng khi “phát hiện các mối đe dọa” trong các mô hình AI.

Ngoài ra, báo cáo khuyến nghị các cơ quan chức năng nên “khẩn trương” xem xét việc kiểm soát việc xuất bản nội dung hoặc hoạt động nội bộ trong các mô hình AI mạnh mẽ. Vi phạm có thể bị phạt tù. Ngoài ra, chính phủ nên thắt chặt kiểm soát việc sản xuất và xuất khẩu chip AI, đồng thời chỉ đạo các quỹ liên bang nghiên cứu để làm cho AI tiên tiến trở nên an toàn hơn.

Báo cáo được thực hiện bởi Gladstone AI, tài liệu cho thấy. Gladstone AI là một công ty có bốn nhân viên chuyên tổ chức các cuộc họp giao ban về công nghệ trí tuệ nhân tạo cho nhân viên chính phủ. Công ty được Bộ Ngoại giao Hoa Kỳ ủy quyền vào tháng 11 năm 2022 như một phần của hợp đồng liên bang trị giá 250.000 USD. Báo cáo được gửi tới Bộ Ngoại giao Mỹ dưới dạng tài liệu dài 247 trang vào ngày 26/2.

Bộ Ngoại giao Mỹ vẫn chưa bình luận.

Riêng biệt, theo lời giới thiệu, ba tác giả đã khám phá vấn đề này bằng cách nói chuyện với hơn 200 thành viên chính phủ, chuyên gia và nhân viên tại các công ty trí tuệ nhân tạo hàng đầu như OpenAI, Google DeepMind, Anthropic và Meta. Một kế hoạch can thiệp chi tiết đã được phát triển trong vòng 13 tháng. Tuy nhiên, trang đầu tiên của báo cáo nêu rõ “những khuyến nghị này không phản ánh quan điểm của Bộ Ngoại giao hoặc Chính phủ Hoa Kỳ”.

Greg Allen, chuyên gia tại Trung tâm Nghiên cứu Chiến lược và Quốc tế (CSIS), tin rằng đề xuất trên có thể gặp khó khăn về mặt chính trị. “Tôi nghĩ đề xuất này khó có thể được chính phủ Mỹ thông qua. Trừ khi có 'cú sốc bên ngoài' nào đó, tôi nghĩ cách tiếp cận hiện tại sẽ khó thay đổi”.

Trí tuệ nhân tạo hiện đang bùng nổ, với nhiều mô hình có khả năng thực hiện các nhiệm vụ mà trước đây chỉ là chuyện khoa học viễn tưởng. Trước vấn đề này, nhiều chuyên gia đã cảnh báo về sự nguy hiểm của nó. Vào tháng 3 năm ngoái, hơn 1.000 tinh hoa công nghệ, trong đó có tỷ phú Elon Musk và đồng sáng lập Apple Steve Wozniak, cũng đã ký một lá thư kêu gọi thế giới các doanh nghiệp và tổ chức tạm dừng cuộc thi trí tuệ siêu nhân tạo trong sáu tháng để xây dựng trí tuệ nhân tạo. trí tuệ cùng nhau. Một bộ quy tắc chung cho kỹ thuật này.

Vào giữa tháng 4 năm 2023, CEO Google Sundar Pichai cho biết trí tuệ nhân tạo khiến ông mất ngủ vào ban đêm vì nó có thể nguy hiểm hơn bất cứ thứ gì con người từng thấy và xã hội vẫn chưa có sự chuẩn bị cho trí tuệ nhân tạo. .

Một tháng sau, một thông điệp được ký bởi 350 nhà lãnh đạo và chuyên gia ngành AI cũng đưa ra cảnh báo tương tự. Một tuyên bố đăng trên trang web của Trung tâm An ninh Trí tuệ Nhân tạo (CAIS) ở San Francisco cho biết: “Giảm nguy cơ tuyệt chủng do AI gây ra phải trở thành ưu tiên toàn cầu, giống như các rủi ro khác ở quy mô xã hội như đại dịch hay chiến tranh hạt nhân”. Tháng 5 năm 2023 mặt trăng.

Một cuộc khảo sát của Đại học Stanford vào tháng 4 năm 2023 cũng cho thấy 56% các nhà khoa học và nhà nghiên cứu máy tính tin rằng AI thế hệ mới sẽ chuyển sang AGI trong tương lai gần. 58% chuyên gia trí tuệ nhân tạo coi AGI là một “vấn đề lớn” và 36% cho rằng công nghệ này có thể dẫn đến “thảm họa quy mô hạt nhân”. Một số người cho rằng trí tuệ nhân tạo nói chung có thể đại diện cho cái gọi là “điểm kỳ dị công nghệ” – một điểm giả định trong tương lai nơi máy móc vượt qua khả năng của con người một cách không thể đảo ngược và có thể gây ra mối đe dọa cho nền văn minh.

Hassabis, Giám đốc điều hành của DeepMind cho biết: “Sự tiến bộ về trí tuệ nhân tạo và các mô hình trí tuệ nhân tạo nói chung trong vài năm qua thật đáng kinh ngạc”. sự giàu có. “Tôi không thấy có lý do gì để làm chậm tiến độ này. Chúng ta chỉ có vài năm, muộn nhất là 10 năm để chuẩn bị.”